IT之家11月16日消息,業(yè)內(nèi)領(lǐng)先的科研機(jī)構(gòu)、美國國家超級計算中心和諸多AI領(lǐng)域龍頭公司,近日聯(lián)合組建了萬億參數(shù)聯(lián)盟(Trillion Parameter Consortium,簡稱TPC)。

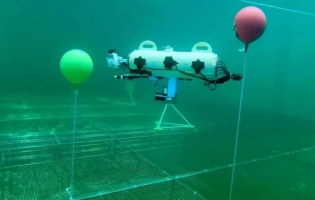

由DALL-E 3生成

IT之家從報道中獲悉,TPC聯(lián)盟由來自全球?qū)嶒炇摇⒖蒲袡C(jī)構(gòu)、學(xué)術(shù)界和工業(yè)界的科學(xué)家組成,目標(biāo)是共同推進(jìn)用于科學(xué)發(fā)現(xiàn)的AI模型,特別關(guān)注一萬億或更多參數(shù)的巨型模型。

TPC聯(lián)盟目前已經(jīng)正在開發(fā)可擴(kuò)展模型架構(gòu)和訓(xùn)練策略,組織和整理用于模型訓(xùn)練的科學(xué)數(shù)據(jù),為當(dāng)前和未來的百萬兆次級計算平臺優(yōu)化AI庫。

TPC旨在創(chuàng)建一個開放的研究人員社區(qū),為科學(xué)和工程問題開發(fā)大規(guī)模生成式AI模型,特別是,將啟動聯(lián)合項目,以避免重復(fù)工作并共享方法、途徑、工具、知識和工作流程。通過這種方式,該聯(lián)盟希望最大限度地發(fā)揮這些項目對更廣泛的人工智能和科學(xué)界的影響。

TPC還旨在創(chuàng)建一個由資源、數(shù)據(jù)和專業(yè)知識組成的全球網(wǎng)絡(luò)。自成立以來,該聯(lián)盟已經(jīng)建立了許多工作組,以解決構(gòu)建大規(guī)模人工智能模型的復(fù)雜性。

培訓(xùn)所需的百萬兆次級計算資源將由美國能源部(DOE)的幾個國家實驗室以及日本、歐洲和其他國家/地區(qū)的幾個TPC創(chuàng)始合作伙伴提供。即使有這些資源,培訓(xùn)也需要幾個月的時間。

美國能源部阿貢國家實驗室計算、環(huán)境和生命科學(xué)副主任、芝加哥大學(xué)計算機(jī)科學(xué)教授里克?史蒂文斯(Rick Stevens)說:“在我們的實驗室和世界各地越來越多的合作機(jī)構(gòu)中,團(tuán)隊開始開發(fā)用于科學(xué)用途的前沿人工智能模型,并正在準(zhǔn)備大量以前未開發(fā)的科學(xué)數(shù)據(jù)進(jìn)行訓(xùn)練。