該模型為機器人智能帶來顯著升級——即便在機器人沒有經歷過的場景下,RT-2也通過學習讓它根據指令完成任務。

谷歌DeepMind機器人技術主管Vincent舉例稱,如果讓以前的機器人丟垃圾,必須要專門訓練它理解什么是垃圾、如何撿起和扔到哪去。現在RT-2能夠從網絡數據上學習識別和處理垃圾的方法,不必逐一特訓不同的場景了。

AI的發展讓機器人的“大腦”實現了物種進化般的迭代,另一面是,機器人失控的風險也隨之增加。

RT-2大模型實現機器人自主學習

ChatGPT的火爆,讓世界見識了大語言模型的強大力量。人們對大模型不再陌生,開始使用基于大模型的應用繪畫、作圖、搜索資料、設計劇情等,而妙用不止于此。谷歌腦洞大開,專門給機器人造了個大模型,讓機器人擁有了自主學習能力。

不久前,谷歌旗下DeepMind發布了一款名為Robotics Transformer 2(簡稱RT-2)的新型視覺-語言-動作(VLA)模型,該模型相當于機器人的專用大腦,能夠指導機器人識別視覺和語言,讓其理解指令并做出正確的操作。

谷歌介紹,RT-2基于Transformer模型開發,根據互聯網上的文本和圖像進行訓練,直接指示機器人執行動作。就像用文本訓練大語言模型學習人類知識一樣,RT-2可以將網絡數據喂給機器人,指導機器人的行為。

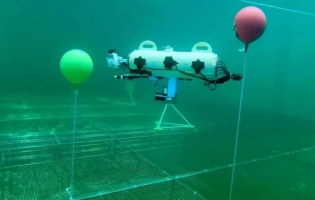

為了展示RT-2的能力,谷歌發布了一個演示視頻,讓搭載RT-2的機器人完成一些它此前從未經過訓練的項目。

視頻中,面對一堆隨意放在桌上的物品,搭載了RT-2模型的機械臂能夠聽懂人類語言并做出相應的反應。

比如,命令它“撿起已滅絕的動物”,機械臂就能從獅子、鯨魚、恐龍這三個塑料玩具中準確選擇恐龍;如果命令它將香蕉放到2+1的總和的位置,機械臂直接把香蕉放在了數字3的位置;再讓它把草莓放入碗里,機器人也能夠無視蘋果、橘子等水果,選對草莓。

不過,在演示過程中,機器人也出現了錯誤,它不能準確地識別汽水口味,這讓它看起來還有不小的優化空間。

即便還不夠完美,但機器人能夠自主理解、推理和執行任務,已經是一個長足的進步。

DeepMind機器人技術主管 Vincent 以“扔垃圾”這個看似簡單的操作舉例,如果想要以前的系統執行丟棄垃圾的行為,必須明確訓練它識別和處理垃圾,而RT-2可以從大量網絡數據中學習并理解什么是垃圾,并在未經特定訓練的情況下進行識別。盡管未曾接受過相關動作訓練,但它能掌握如何丟棄垃圾的方法。“考慮到垃圾的抽象性,比如各種薯片包或香蕉皮在你食用后就成為了垃圾,RT-2 能通過其視覺語言培訓數據理解這個概念,并完成任務。

RT-2就給機器人輸入了認知能力,讓它能夠在互聯網上學習和進步,甚至還能進行一般推理。這對于機器人產業來說,不亞于一次物種進化。

機器人加速進化再觸AI安全底線

事實上,給機器人裝上大腦這件事,谷歌并不是第一次嘗試了。就在去年12月,谷歌發布了RT-1大模型,它可以標記機器人輸入和輸出的動作,在運行時實現高效推理,并使實時控制成為可能。

RT-1模型是在一個包含130k個“情景”的大型真實世界機器人數據集上訓練的,該數據集涵蓋700多項任務,由13臺機器人在17個月內收集而成。也就是說,RT-1大模型可以讓單一機器人,學習其他機器人在過去積攢的經驗,從而具備相應的能力。

當時,谷歌讓搭載RT-1的機器人進行一系列復雜操作,包括拾取和放置物品、打開和關閉抽屜、將物品放入和取出抽屜、將細長的物品直立放置、敲倒物體、拉出餐巾紙和打開罐子。據團隊稱,RT-1 以 97% 的成功率執行了 700 多個訓練指令,并且可以泛化到新的任務。

但對于沒有具體學習過的場景,RT-1還是很難自主依據推理完成任務。根據測試,它在不熟悉的場景下,操作的準確率只有32%。

如果說當時的RT-1還是個“教什么學什么”的小學生,RT-2則進步成了能夠舉一反三的初高中生。在沒見過的新場景中,RT-2 的性能表現幾乎翻了一番,從RT-1的32%提高到了62%,而此時距離RT-1的發布時間僅僅過去了半年多。

谷歌 DeepMind機器人技術主管Vincent 解釋,RT-2 建立在 RT-1 模型的基礎上,消除了一些復雜性;使單個模型不僅能夠執行基礎模型中看到的復雜推理,而且還可以輸出機器人動作。最重要的是,它表明在少量的機器人訓練數據下,該系統就能夠將其語言和視覺訓練數據中嵌入的概念轉變為指導機器人行為,即使是從未接受過訓練的任務。“簡而言之,RT-2 的能力在于將信息轉化為行動,這顯示了其快速適應新環境和情況的潛力。”

得益于大模型的快速進步,機器人產業迎來了質變,按照谷歌的迭代速度,或許明年就能看到更強大的RT-3。

研究機器人的不止谷歌,特斯拉也對機器人興趣濃厚。今年5月,特斯拉發布了一個視頻,5個人形機器人在工廠中直立行走,它們裝備了很多傳感器,能夠探測周圍環境,執行分揀物品等任務。特斯拉的機器人也在走AI路線,這家電動汽車廠商的CEO馬斯克稱,特斯拉正在嘗試打通電動汽車的輔助駕駛軟件(FSD)系統和人形機器人的底層模塊,讓機器人智商在線。

而倘若后續特斯拉機器人能夠接入RT-2甚至更高級的大模型,機器人的能力預計又將大幅進步。

但越來越聰明的機器人,也加劇了人們對AI失控的擔憂。大模型的軟件應用可能會在網絡學習中操控人類的思想、輿論,金屬外殼的人形機器人直接具備了物理殺傷力。

有人在社交媒體發問,“人類是否親手打開了一個潘多拉魔盒?”

如何規訓機器人,仍然回到了大模型安全性這一老問題上,但這個問題至今還未在全球的研究與應用領域達成共識。

技術另一面的未知危機仍未解除,裝上AI大腦的機器人出現了,你會期待還是警惕?